Alarmismo e inteligência artificial

Mais de 1 mil personalidades, de Elon Musk a Steve Wozniack, passando por Yuval Harari e Tristan Harris, publicaram uma carta aberta pedindo a suspensão de “grandes experimentos com inteligência artificial (IA)”.

A presença proeminente na lista de figuras como Harari, que tem difundido um alarmismo incompreensível em jornais de grande circulação, e de Musk, que dispensa comentários, já seria sinal de alerta.

O fato de ter sido publicada pelo Future of Life Institute, um think tank cuja missão é “reduzir a catástrofe global e o risco existencial de tecnologias poderosas”, promotor assíduo do “longoprazismo” e financiado por gente como Musk (que compõe o conselho), é outro.

A carta compra pelo valor de face as promessas da indústria, das empresas que produzem e vendem essa tecnologia. É uma situação paradoxal em que o pedido por comedimento valida o problema trazido à tona.

Ou, como diz a professora da Universidade de Washington, Emily Bender, a carta aceita e potencializa o #AIhype, o frenesi que acompanha tecnologias vendidas como algo além do que são capazes — vide web3 e metaverso.

O principal pedido do signatários é direcionado aos laboratórios de IA: uma pausa voluntária de pelo menos seis meses no “treinamento de sistemas de IA mais poderosos que o GPT-4”.

O próprio pedido é esquisito. O que aconteceria nesses seis meses? É improvável que a Microsoft, depois de injetar US$ 10 bilhões na OpenAI, demitir seus especialistas em ética para IAs (ação replicada por Google e outras) e enfiar IA em todos os seus principais produtos, teria uma crise de consciência que culminasse numa mudança de curso.

Por outro lado, não se chega a nenhum tipo de consenso regulatório em tão pouco tempo. A União Europeia levou anos para aprovar duas leis que põem rédeas nas big techs norte-americanas, ambas prestes a entrar em vigor.

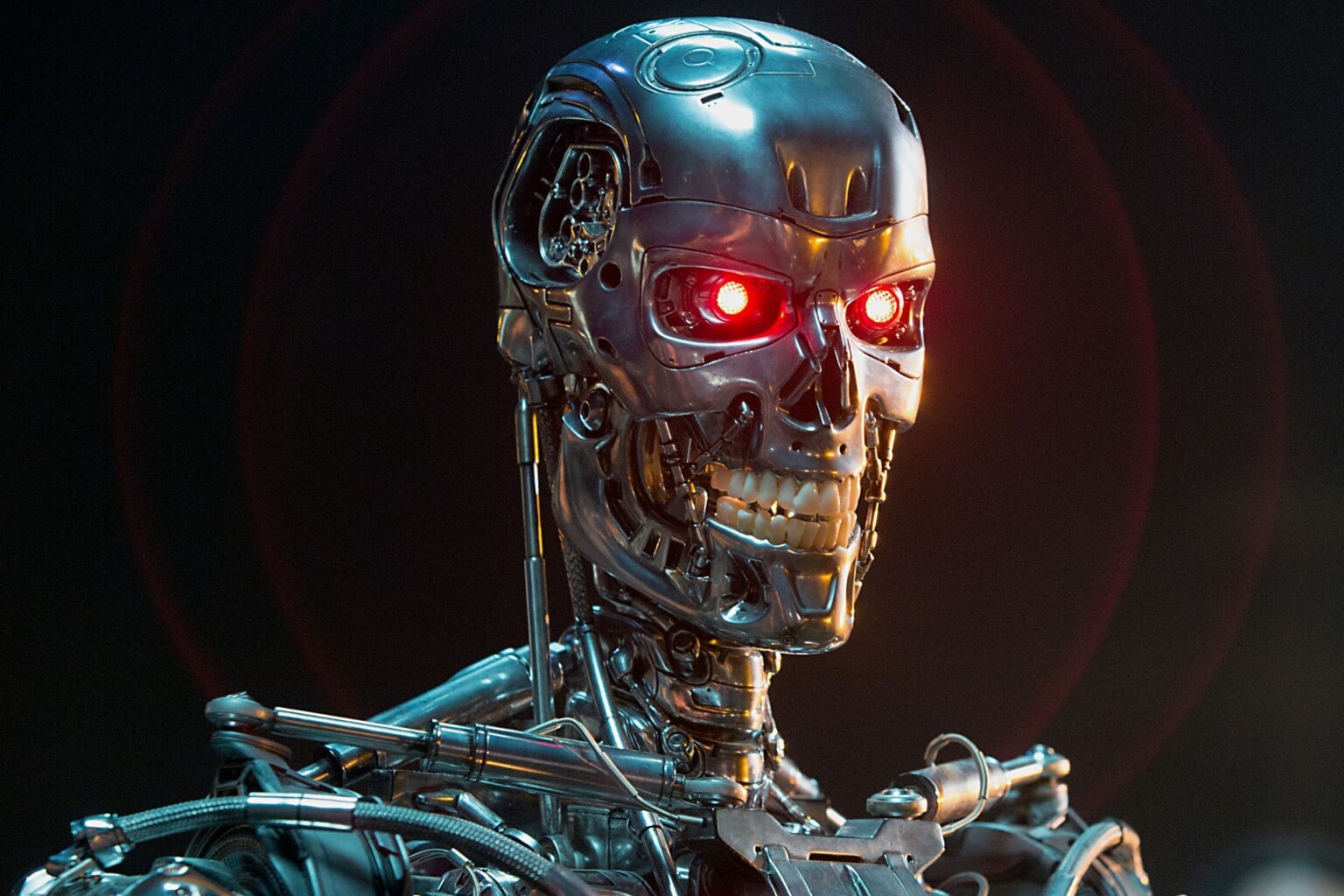

O problema maior, porém, é a narrativa que a carta e seus signatários promovem, de que a IA seria “muito poderosa” e que o maior risco que corremos é ela adquirir consciência e se voltar contra a humanidade.

A carta transcreve o trecho de uma baboseira escrita por Sam Altman no site da OpenAI em que ele expõe receios acerca da inteligência artificial geral (AGI, na sigla em inglês) e que, óbvio, somente gente como ele e empresas como a OpenAI estão em posição de lidar. “Concordamos”, dizem os signatários.

Não há qualquer indício de que estejamos perto ou que seja possível criar AGIs.

O texto da Emily é competente em rebater os argumentos fajutos dessa galera. Ela é coautora de um paper marcante, escrito ao lado de Timnit Gebru e publicado em 2021, que alertava para os perigos dos grandes modelos de linguagem, a tecnologia fundamental de IAs como o ChatGPT.

Na época, Timnit, que trabalhava para o Google, foi demitida por ter publicado o paper. Decepcionante, mas não surpreendeu.

Dois pesquisadores da Universidade de Princeton, Sayash Kapoor e Arvind Narayanan, compartilham o ceticismo de Emily. Neste texto, a dupla sintetiza os problemas da carta em um parágrafo:

Concordamos que desinformação, impacto no trabalho e segurança são três dos principais riscos da IA. Infelizmente, em cada caso, a carta apresenta um risco especulativo e futurista, ignorando a versão do problema que já está prejudicando as pessoas. […] Ela opera segundo as regras das empresas que visa regular.

Em vez dessa bobagem de “IA super poderosa”, deveríamos nos preocupar com as empresas e os investidores super poderosos, que usam qualquer tecnologia disponível — incluindo a IA — para concentrar e exercer um poder desmedido. Se existe alguma ameaça existencial à humanidade, essa parece uma bem maior que a das IAs.

Foto do topo: Paramount/Divulgação.

Ler “compra pelo valor de face…” em português dói um pouco a retina…

Scott Aaronson, pesquisador na OpenAI, publicou o abaixo em seu blog sobre o assunto.

https://scottaaronson.blog/?p=7174&fbclid=IwAR1H48jF8hiuZe3ri5mpzmCPVnI2lSn0um12kn-zLVLYbo_Ewl3dUlH2xm4

Minha boca já não tem mais onde cair. Sempre leio os hyperlinks dos debates como estes pra me ancorar na realidade, e me questionar se habito o mesmo espaço-tempo social que essa galera.

Como umas correntes/hypes dessas a cada X em X anos na Internet aparecem, são financiadas por bilionários com fama de curto-prazo, se tornam debate online, assunto de YouTube, artigo da Vox, desaparecem, e fico pensando: meu Deus, como a era da informação é insana… E ainda temos uma indústria de consumo, para abrigar pessoas que escrevem, curam, leem, gravam vídeos, debatem e moderam assuntos como esse, que vão e vêm no hypecycle das mídias sociais: longoprazismo, futurismo, neoestoicismo, transhumanismo, ‘escolas estéticas’ de tik-tok, wtf… Tento olhar para isto e o tradicional ciclo de vida-sobrevivência e de debate das correntes e ideias filosóficas antes do online clout se tornar moeda, recurso, economia.

Se a gente só desse mais atenção a aprender como cuidar de jardins e dar banho em cachorro, manutenção de motor de carro. Nossos rios cheios de mercúrio, metade de população sem acesso a esgoto e a internet aquecida debatendo o futuro da inteligência artificial e se o Metaverso “is stil a thing”. E daí?

AI é muito diferente de web3 e metaverso.

Nesse estágio inicial de ida à público, já tá causando real impacto no trabalho de muita gente.

Eu conheço empresa que trocou 4 programadores por $20 doláres e ChatGPT.

Eu conheço videomaker que demitiu roteirista.

Eu conheço empresa que demitiu o carinha que fazia post pro instagram.

Mas, tudo bem, é “alarmismo”. É tipo os dinossauros vendo o meteoro e “calma gente, vamos ser céticos, nunca aconteceu nada assim antes, vamos com calma, nem é pra tanto”.

Em momento algum disse que não há motivos para escrutínio e preocupação com IA. Minha crítica está no objeto da preocupação.

A dizimação de postos de trabalhos é uma bem válida, que já abordei aqui em outras oportunidades. Agora, que a “IA é muito poderosa”, vai adquirir consciência e acabar com a humanidade? Alarmismo.

Acho que concordamos que as IAs que já temos hoje são tecnicamente (e mecanicamente) muito eficientes pra realizar o que “se propõem” a fazer. Com a evolução exponencial delas, alimentada pela busca desenfreada de empresas – que visam o lucro acima de tudo – com dinheiro em caixa equivalente ao PIB de muitos países, é bem provável que, em alguns anos ou décadas, elas consigam ter consciência – ou uma eficiente imitação disso. Quando isso acontecer, elas serão como nós: terão suas próprias demandas e, principalmente, lutarão pela sua sobrevivência, se necessário em detrimento de outras vidas – exatamente como nós fazemos.

Considero um erro pensarmos hoje com a mesma ideia – romântica – sobre a robótica que Isaac Asimov e seus contemporâneos tinham: que, mesmo se conscientes, os robôs SEMPRE seguirão as NOSSAS regras.

Ainda nem conseguimos nos adaptar completamente às mudanças iniciadas na Revolução Industrial… Mas é interessante notar que muitos que consideram urgentes e necessárias as questões sobre as mudanças climáticas, por exemplo, e que são (erroneamente) tachados de alarmistas por isso, são os mesmos que tacham de alarmistas quem defende melhores práticas e controles sobre essa “corrida IAmentista”.

Talvez, se a galera dessa carta fosse mais diversa e igualitária, com menos homens brancos e mais mulheres e negros, por exemplo, suas questões fossem – ou merecessem? – ser mais levadas à sério, né?

Podem fazer cartinha, subornar governo, xingar no twitter…. Não tem como parar a aplicação disso!

Essa “tirinha” é um resumo de como que vejo o que irá acontecer com as empresas que estão substituindo pessoas por AI

https://workchronicles.com/wp-content/uploads/2023/03/glimpse-of-the-future-01-2.png

“Eu conheço empresa que trocou 4 programadores por $20 doláres e ChatGPT.”

Cara, este seu exemplo é tão contundente, que eu acho muito difícil acreditar.

O “tempero” que IA trás, diferente de Metaverso/Blockchain/etc, é que além de não sabermos as implicações sociais dela, é um problema que esses modelos gigantes são cada vez mais inescrutináveis.

Isso corrobora muito para esse alarmismo sem foco, ainda mais pela questão da cultura pop de robôs assassinos, mas concordo que é uma grande bobagem ficar se desesperando com isso agora.

Aí ficam nessas viagens, que para ser honesto nem acho tão absurdo pensar em termos acadêmicos e filosóficos, porque não é bem definido o que seria uma AGI: a depender da sua definição, há indícios de AGI nos LLM.

Mas não é algo que seja um problema real a ser resolvido, nem me importa a opinião de 90% dessa lista sobre o assunto.

“Pause por 6 meses pra gente encontrar algo equivalente pra competir, POR FAVOR”

Logo eles apelam “hey, governo, me ajude a proibir a concorrência”

Suspeito que tem gente dessa lista arrancando os cabelos por não estarem faturando com essa corrida.

Então acho que esses 6 meses são o tempo para que saiam da desvantagem.

Se o Yuval Harari e o Elon Musk assinam algo juntos, é óbvio que haverá muita canalhice conveniente envolvida.

Conte mais sobre o Yuval Harari. Já que ele é autor de livros bem famosos.

O mais canalha dos canalhas, um verdadeiro leecher de oportunismo filosófico.

Não há qualquer indício de que estejamos perto ou que seja possível criar AGIs.

Bem…

“Microsoft Research Paper Claims Sparks of Artificial Intelligence in GPT-4”. Google it.

“Sparks of Artificial Intelligence”. Não é inteligente, OK, mas não é necessariamente apenas matemática.

Até 1 mês atras eu era cético que IA como em ficção nunca ocorrerá. Nunca. E ainda acho isso hoje! Skynet? QUERO! Mas sorry, não vai acontecer… apenas não tenho tanta certeza mais:

Em 1 ano atras eu dizia que nunca uma maquina vai passar no tuning test. “Nunca”. E olha agora.

A Emily também comentou esse paper mandrake da Microsoft sobre “sparks” de AGI, que, no texto linkado no post, ela chamou de “novela de especulação fictícia”.

Cara tem outro problema, o que é AI.

Por um lado ela pode nunca pensar sozinha, isso ela não tem capacidade. Ela sabe resolver problemas dado a ela e termina ali. Não tem criatividade (hoje?).

Por outro lado ela passa e entre as 90% melhores notas da “OAB americana”. Tem como conceber ela sendo nesse exemplo uma advogada um dia? Não é pensar, é usar o que sabe (lei e acontecimentos do reu) para argumentar e chegar em um resultado. Isso “não é pensar”, é responder até o resultado desejado. Ou é sim pensar, apenas não de forma criativa. E isso é inteligencia?

É inegável que IA passa bem em alguns domínios que, até pouco tempo atrás, eram exclusivos do ser humano. Só que isso não é “inteligência”, muito menos consciência. Muitos especialistas criticam a terminologia, e com razão, porque além de imprecisa, ela potencializa delírios como o presente nessa carta aberta.

De tudo que li, o ensaio do Ted Chiang foi a melhor coisa (ainda que ele use uma analogia) para destrinchar o que essas IAs colocam à mesa de fato e quais as suas limitações.

Beleza mas esse é o ponto. Antigamente era inteligencia artificial uma maquina ganhar no xadrez (Deep Blue), e então era saber responder em conhecimentos gerais (Watson), e então era, claro que era, o tunint test.

Hoje sabemos que mesmo passando o tuning test não é inteligente. Nosso nível de exigência subiu outra vez.

Não quero afirmar que um advogado defendendo um reu é sinonimo de inteligencia (pois um computador pode fazer o mesmo e não é!). Mas mesmo que não seja: esse software consegue responder a problemas de forma humana, e mesmo que seja “burro” ele já tem hoje potencial de fazer serviços reais nossos, os bons não apenas os de girar uma manivela.

Pode ser alarmismo AI – mas pode não ser! E o simples PODE tem de fazer todos nós nos assustarmos! Se um cometa viesse para a terra com 1% de chance de destruir em 100 anos não iriamos pensar “para, 99% de chance de nada, não vai dar nada” .

Agora mesmo que seja alarmismo AI, ela assim burra pode mudar o mundo em alguns anos.

..

E pode ajudar quando o cérebro simplesmente se nega a dar informações necessárias para um post.

https://sharegpt.com/c/7Pse0dW

https://sharegpt.com/c/JOjxv5A

https://sharegpt.com/c/HTro3DA

:)

Mas o que é inteligência, não é mesmo? E se nós humanos somos também uma máquina de plágio, tal como são os programas de machine learning que temos hoje? Talvez a única grande diferença é que tenhamos um corpo pra estar exposto ao mundo real e ter mais input do que um programa 100% virtual. Mas e quando esses sistemas forem implantados em robôs? Vale uma conferida no experimento filosófico chamado Chinese Room: https://en.wikipedia.org/wiki/Chinese_room

Imagina um documento similar pedindo para a Tesla suspender o seu programa de direção autônoma até que maiores análises e avanços sejam concluídos…

Gostaria de ver a reação do Elon Musk nesse caso ai. 😃